最近AI绘画的开闭源模型很热闹,图像编辑模型是大热,开源有kontext dev和qwen edit,闭源的最强王者google的gemini 2.5 flash image(nano banana)。

今天围绕“提取”的场景,看看三者之间的表现。这次任务需要:提取图案印花和提取衣物。

- kontext提取的能力:

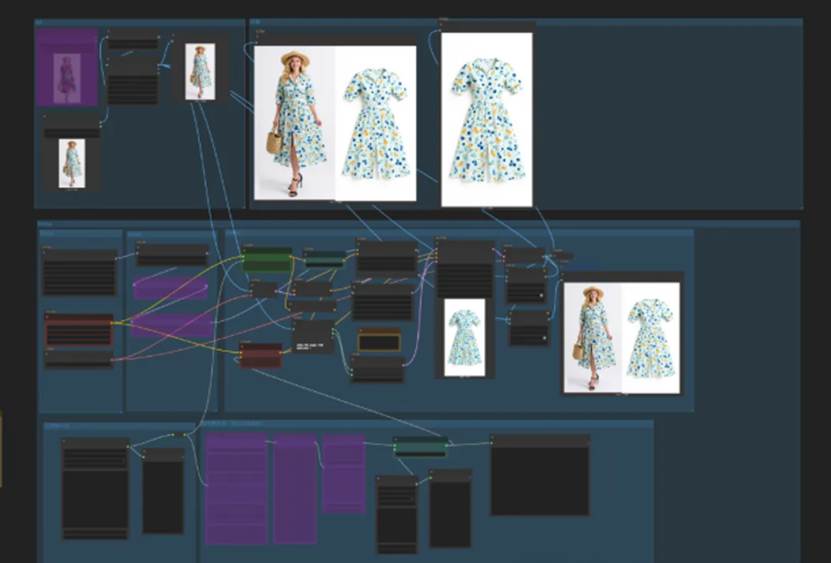

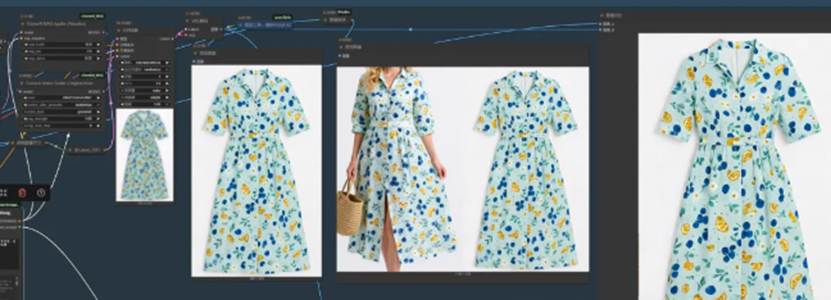

- 打开我们的closerAI 万物提取的工作流:

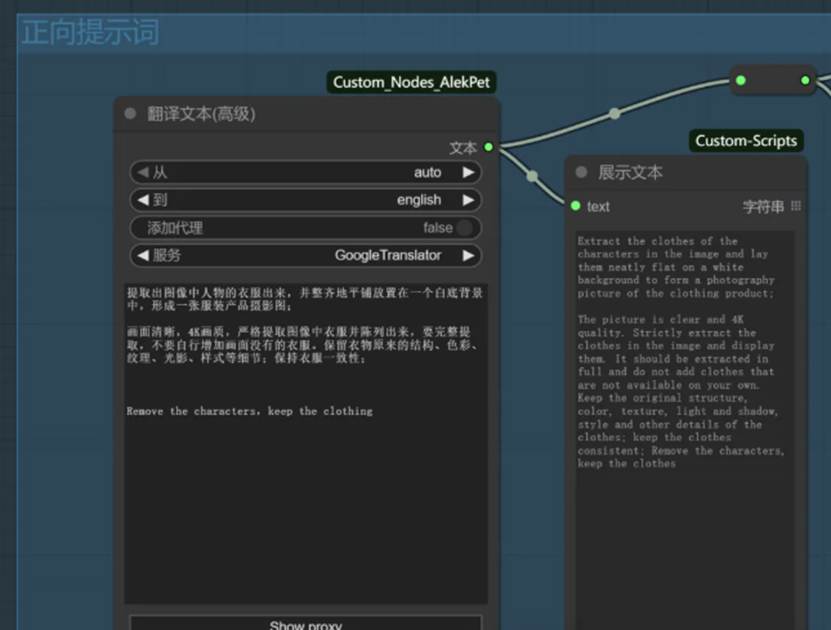

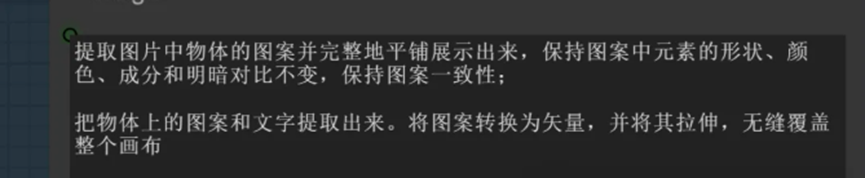

- 工作流主要思路是使用NAG技术,提示词写上:

- 反向提示词也写上:

- 运行工作流后得出:

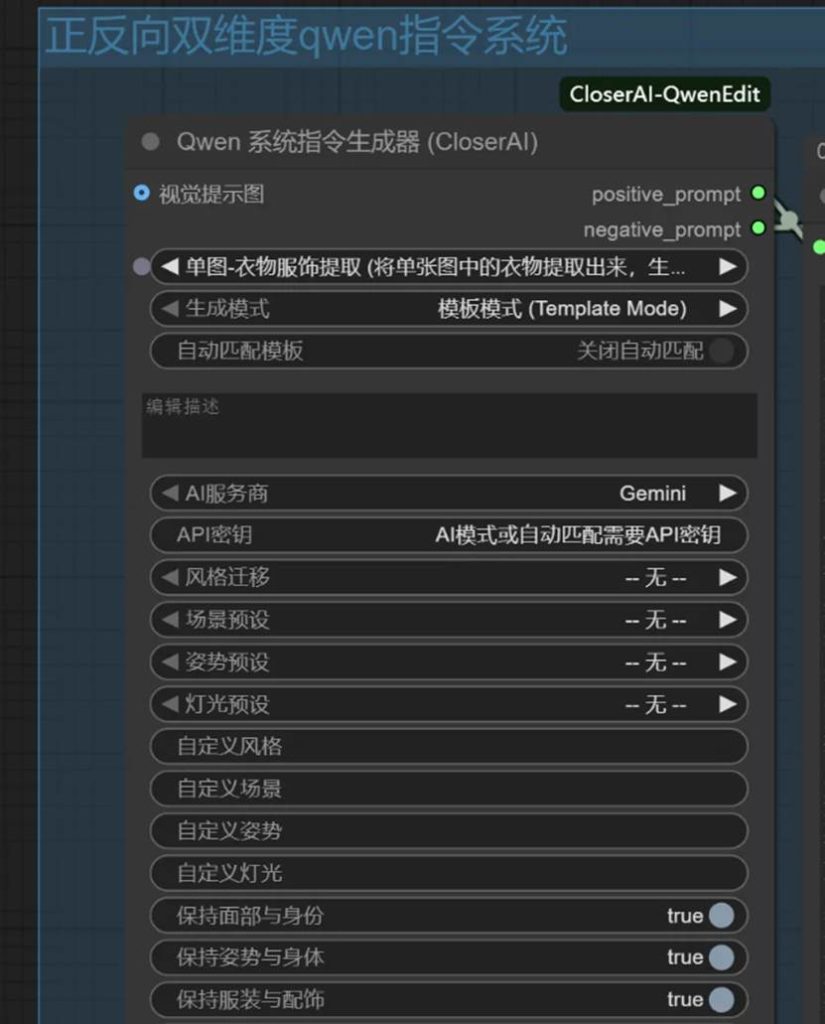

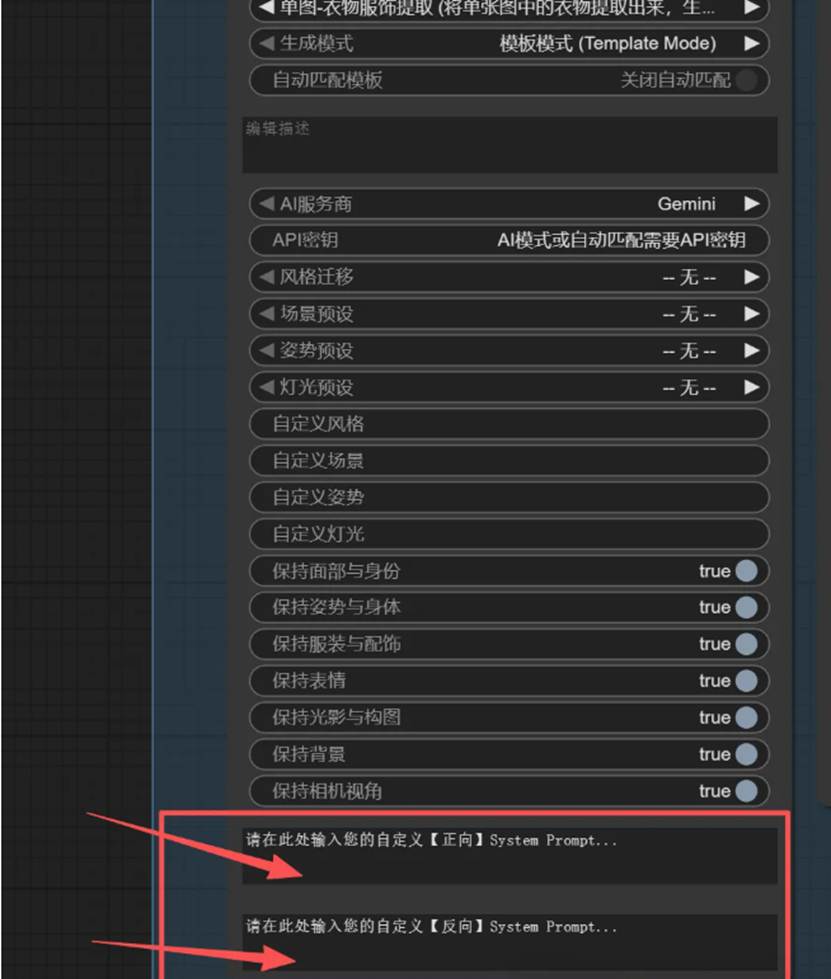

- qwen-edit提取能力

- qwen-edit是有这个能力的,这个能力的释放得益于之前我开发的节点

- 这次更新我加入了“图案印花提取”和“衣物提取”的qwen系统指令。

- 同时加入了自定义模板,大家可以自己添加自己的模板,这样更自由。

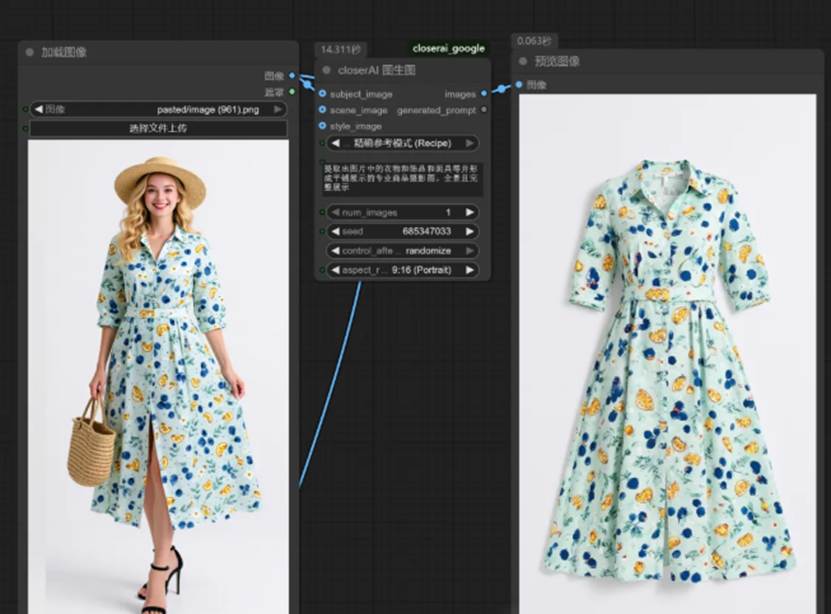

- 打开我们的closerAI qwenEdit万物提取工作流:

- 使用很简单,选中我们的衣物提取模板。

- 正反向提示词这样写:

- 直接运行工作流:

- nano banana提取能力

- nano banana最近太火了,我也开发了一个节点,不多说,我这个节点肯定是(逆向实现的),将羊毛薅到底。

- 我们可以看出,三个模型在提取衣物上都能成功。我们没有其它LORA的加持,kontext通过正反提示词+NAG来实现的,qwenEDit是通过双向qwen系统指令来实现的。

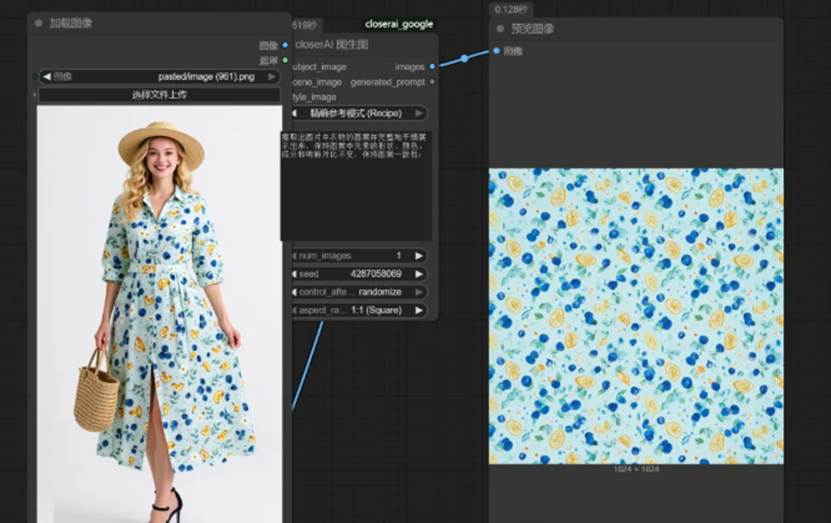

我们来看看它们的提取图案印花方面的能力:

下面提示词统一是:

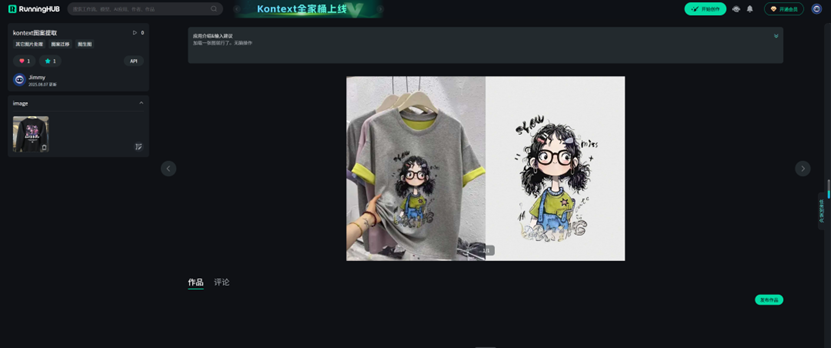

- kontext dev的图案印花提取能力

2、qwenEdit的图案印花提取能力

3 nano banana的提取能力

本地算力不够怎么办?

如果本地设备算力不好的小伙伴,推荐使用线上comfyUI来运行体验:runninghub.cn

Flux Kontext Dev图案提取体验地址:

注册地址:https://www.runninghub.cn/?utm_source=kol01-RH151 通过这个链接第一次注册送1000点,每日登录送100点

最后几句:

kontext万物提取使用NAG技术加持,正反提示词即可提取。qwenEdit也有这个能力,但如果你使用基础流,一般很难出效果,因为使用的是通用的qwen系统指令,经过迭代后,开发出对应的qwen指令生成节点,内置对应场景的特定系统专属指令,让任务更明确,减少抽卡概率。