英文里“Data Ingestion”和“Data Integration”看上去很相似,只差几个字母,翻译成中文分别是:“数据提取”与“数据集成”,从字面理解,也像是差不多的意思,都是把数据拿进来用?

那今天我们就来说说这两个长得像、听起来差不多,其实职责完全不同的数据角色——它们在企业数据管道中分别有什么特点?负责哪一步?各自又解决什么问题?

数据提取

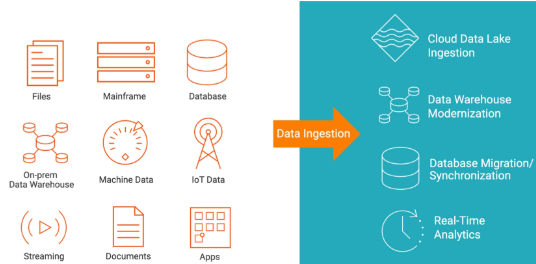

数据提取,简单来说,就是把数据“收进来”。

它指的是将数据从各种来源(比如数据库、日志系统、文件、IoT设备)转移到统一的存储环境(如数据湖或数据仓库)中,以供后续处理。

数据提取是整个数据生命周期的第一步,也是一切数据治理、分析工作的起点。

数据提取也涵盖多种方法,包括批处理提取、流式提取、混合提取,无论是需要立即访问数据还是定期更新,每种方法都能满足特定需求,通过有效地处理数据提取,可以确保原始数据可供进一步处理和分析。

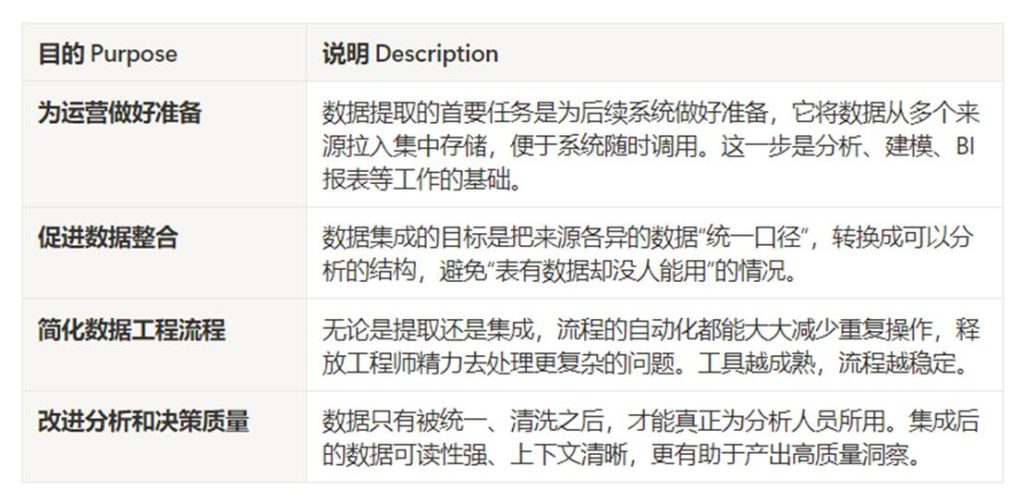

数据提取的目的

数据提取的主要目标是确保数据在需要时可被访问和使用,在现代数据管理体系中,数据提取的意义可以从多个维度展开理解,例如——它如何为系统运行打下基础、如何推动数据整合、如何提升数据工程效率,以及最终如何影响分析质量与业务判断。

数据提取的“分段式结构”

完整的数据提取链路大致可以分为以下几个部分:

1、数据源层

一切从源头开始,无论是数据库、日志系统、API 接口,还是 IoT 设备,这些系统中产生的原始数据都构成了提取的“原料池”。

2、连接与采集层

数据能否被提取,取决于连接器的能力,这一层负责接入数据源,确保认证信息、访问权限、数据协议等都能顺利对接,并能根据设定选择提取哪些字段、何时提取。

3、暂存与缓冲层

在数据进入目标平台前,通常会经过一个“缓冲区”,这可以防止网络波动或写入异常造成数据丢失,也能支持批量整理与传输重试。类似于电商的“中转仓”。

4、传输与路由层

数据的真正流动往往通过两种模式完成:批处理和流式传输,前者按固定时间批量搬运,后者则以实时、持续的方式不断接收更新。

5、加载层

最终,数据被写入到目标平台,如数据湖、数据仓库、NoSQL 存储或中台系统,加载时可能还会做轻度的类型校验或结构调整,确保能顺利落地。

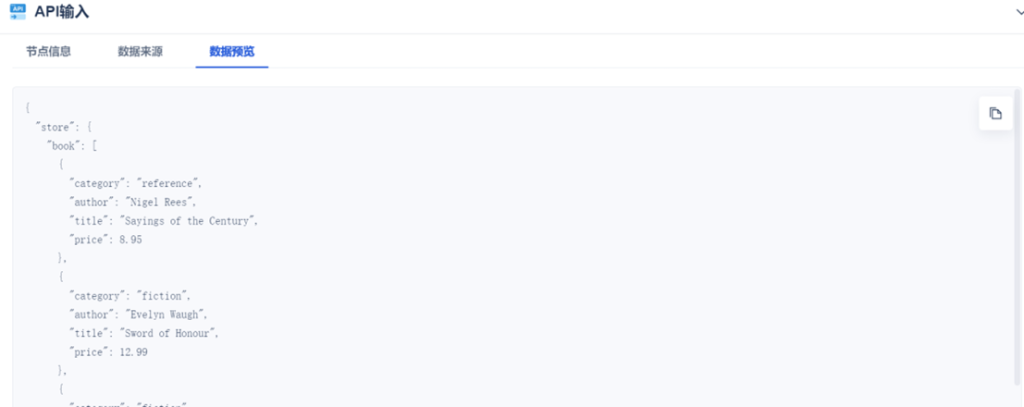

在众多数据提取方式中,FineDataLink 在 API 数据处理方面展现出较强的灵活性和工程适配能力,平台支持自定义 Header 参数,可灵活设置关键字段,满足多种鉴权方式下的数据请求需求,此外还能够兼容 JSON、XML 等常见返回格式,并自动解析多层嵌套结构,大幅降低数据结构复杂性对开发的干扰。

更具实用价值的是,FineDataLink 提供了可视化的接口调试与实时数据预览功能,开发者在接入过程中即可直观查看接口返回数据,快速完成字段映射与解析逻辑配置。

数据集成

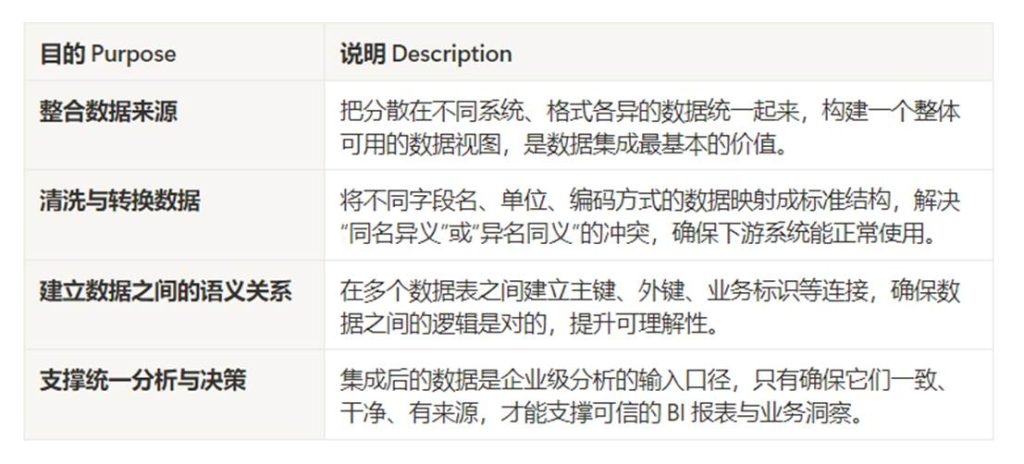

数据集成的本质,是将多个来源的数据组合成一份统一、可用的全景视图,它不是简单地拼接,而是要解决格式冲突、语义不一致、字段重复、数据缺失等问题。

与专注于将数据引入系统的数据提取不同,数据集成确保数据协调一致且随时可用,其主要目的如下:

在实际工作中,数据集成并非一成不变,根据不同的场景、系统架构、业务需求,可采取不同的数据集成方式,具体可分为以下5类:

1、手动数据集成

最原始的方式,由人工在两个系统之间手动提取和导入数据,常见于小型项目或临时需求场景。缺点是费时、容易出错,不具备可扩展性。

2、中间件数据集成

通过引入中间层系统(如 ESB 总线、ETL 工具)完成数据在多个系统之间的自动交换,这种方式较为通用,适合已有系统较多、需要协调调度的企业。

3、统一访问层

也叫逻辑集成,不移动数据,而是建立一个统一视图来访问多个数据源,数据依旧保留在原系统,适合对时效性要求高但数据不必集中存储的业务。

4、应用集成

借助各系统的 API、SDK 等接口进行数据交互,是当前 SaaS 系统之间集成的主流方式,灵活性高,但对接口规范和开发资源要求较高。

5、数据仓库集成

把所有数据集中存储到一个平台(如数据仓库或数据湖),并在其上建立统一建模和分析体系,是物理集成的典型代表,适用于数据治理成熟的大型组织。

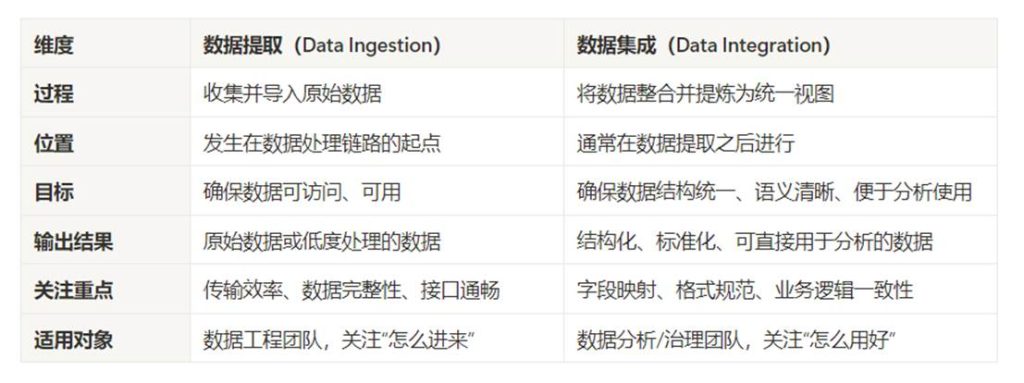

区别与联系

前面我们分别介绍了数据提取与数据集成的定义、流程和目的,它们一个负责“把数据接进来”,一个负责“把数据整理好”,看起来环节相邻、名字相近,但其实职责分工明确,各有侧重。

1、关注点不同

- 数据提取关注的是“来源”与“传输” ,处理的是数据怎么从业务系统进入平台,强调通路打通、接口兼容、传输稳定、准实时或批量调度等能力。

- 数据集成关注的是“结构”与“语义” ,处理的是数据进入平台后如何整理并统一使用,强调字段映射、格式规范、模型合并、语义对齐、加载使用等过程。

2、所在位置不同

- 数据提取处于数据链路的起点,决定平台能不能实时获得完整数据;

- 数据集成处于数据治理的中段,决定数据能否被理解和分析。

3、间接影响目标不同

- 数据提取做不好,问题往往表现为:数据延迟严重;接口失败频发;同步不全导致数据不完整。

- 数据集成做不好,问题则更多体现在:报表口径混乱;字段含义不清;数据“有但不能用”,甚至误导业务判断。

总之,实际落地中,数据提取和数据集成往往需要分工具实现、分角色负责、分阶段治理。只有它们配合得好,才能真正让数据流通起来,并被业务高效使用。