“未来的数据中心不是在烧电,而是在烧带宽。”

这不是一句夸张的形容。AI的大模型训练,把全球数据中心拖进了一场带宽与能耗的战争。今天的传统光模块,正像是一条被巨轮碾压的老旧高速路,已经无法承载AI集群疯狂涌动的“算力车流”。

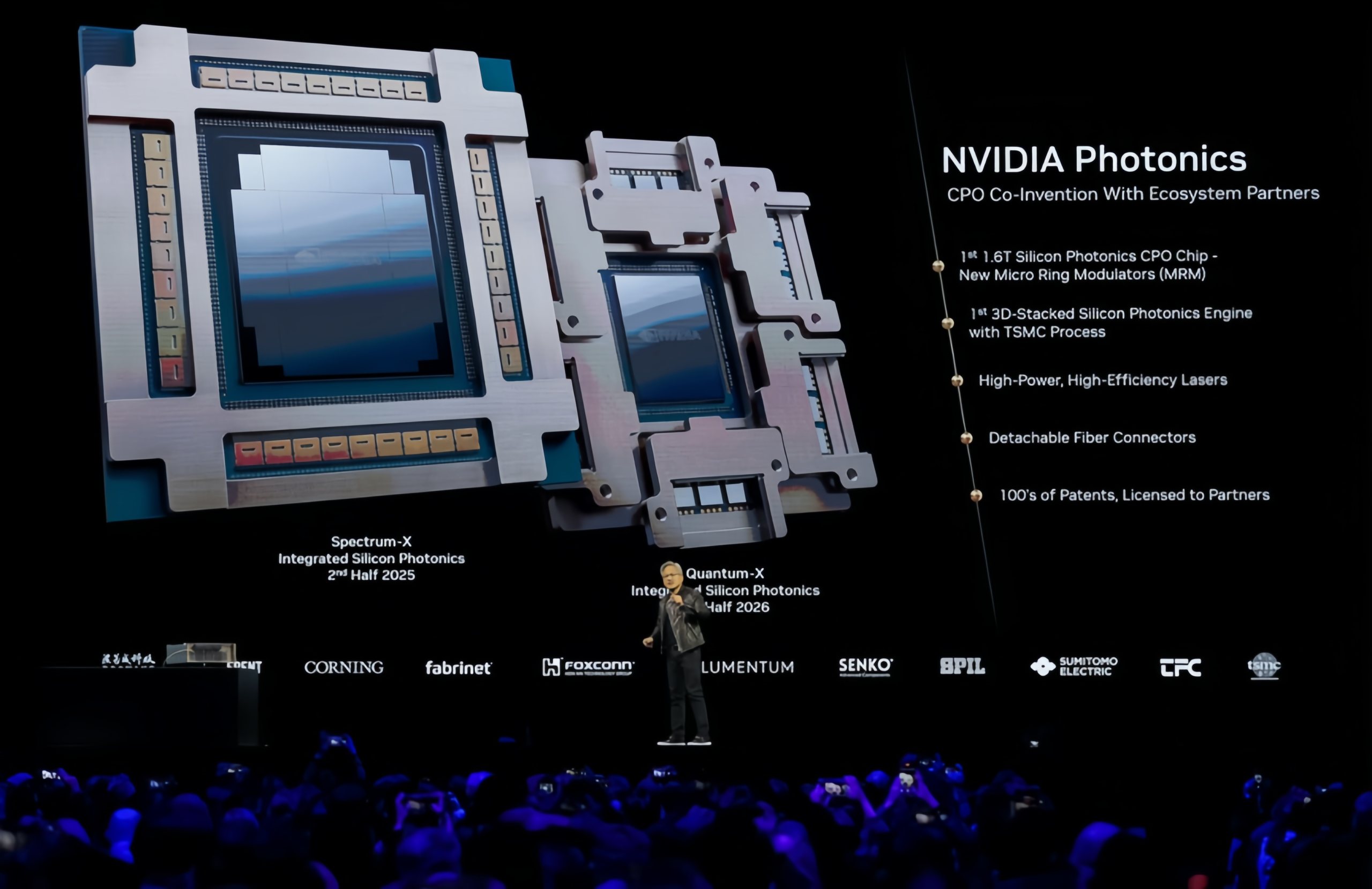

就在这种压力下,CPO(Co-Packaged Optics)横空出世——它不是一个更快的模块,而是一场彻底的架构革命。

传统数据中心的“带宽困局”

“未来的数据中心,不是先被电费压垮,而是先被带宽拖死。”

过去几年,大模型训练掀起了AI算力的军备竞赛,GPU成百上千地堆在同一个数据中心里,吞吐的数据量惊人。然而传统网络架构正在逐渐失效——再快的可插拔光模块(Pluggable Optics)也追不上AI集群的速度需求。

传统方案的三个核心问题是:

- 电信号距离太长。 SerDes功耗高企,电到光的转换效率越来越低。

- 延迟过高。 对于AI训练来说,几毫秒延迟就意味着算力浪费。

- 能耗失控。 数据中心的PUE(电能利用率)接近极限,而网络部分已经成为耗电大户。

“带宽,成了AI工厂的命门。”

CPO的出现:把光“收进”芯片

CPO(Co-Packaged Optics)并不是在原有模块上堆料提速,而是重写了整个交换架构。

它将光引擎与交换芯片直接封装在一起,缩短了电信号传输距离,几乎让“电走线”这件事从数据中心核心网络中消失。

相比传统可插拔光模块,CPO的优势非常直接:

- 带宽提升一个量级。 单通道速率可达400G甚至更高,未来6.4T CPO正在路上。

- 能耗大幅下降。 功耗可降低30%-40%,这对于AI数据中心意味着成吨电费的节省。

- 高集成度。 光、电、封装三合一,极大减少物理接口带来的能耗和带宽损耗。

这不是一个“模块升级”,而是网络基建的重生。

AI推动CPO:一场供给侧革命

AI大模型的爆发,让网络成为新的瓶颈。为了训练GPT-5、Sora这类超大模型,数据中心需要连接上百万GPU。传统铜缆和可插拔光模块已经力不从心,CPO是唯一能满足AI规模化需求的路径。

为什么AI离不开CPO?

- 大模型的带宽黑洞。 单一交换节点的吞吐量需要支撑数百Tbps,没有CPO几乎不可实现。

- 铜缆已到极限。 传输距离和能耗问题让铜缆退无可退。

- 能源和散热压力。 传统光模块功耗高企,而CPO的高能效比让其成为降能耗的核心方案。

未来五年,随着Nvidia、Broadcom、Intel等巨头推动,CPO将快速替代AI集群内部的传统互联。行业预计,到2030年CPO市场规模将突破 80亿美元,年复合增长率超过 130%。

“AI不是在等更快的网络,而是在逼着通信产业进化。”

CPO vs. Pluggable:替代还是共存?

短期内,CPO不会完全取代可插拔光模块。

- 在计算节点(Server到TOR)的互联上,Pluggable依然因灵活性而存在。

- 在GPU背板、交换芯片到芯片的互联上,CPO会成为AI集群的“骨干”。

未来几年,行业将进入“混合架构”阶段:

- Pluggable光模块会演进到1.6T甚至3.2T;

- CPO则率先在AI训练集群落地,并在2028年前后实现全面普及。

“CPO的出现,不是淘汰,而是重构。”

未来:CPO是一条“光速高速路”

如果说GPU是AI工厂的“发动机”,那么CPO就是未来数据中心的“光速高速路”。

它不仅解决了带宽、功耗和延迟的三重瓶颈,还将带来整个产业链的洗牌:

- 芯片巨头必须在光电集成上持续投入。

- 封装厂(如先进的2.5D/3D封装)成为核心环节。

- 光芯片厂、材料厂、光纤厂,全面迎来技术竞赛。

未来的AI网络架构,不再是“堆更多GPU”这么简单,而是如何把每一块GPU的算力 “光速释放”。CPO,是这场革命的中枢。

“AI的尽头不是算力,而是带宽。CPO,正在打开一条光速之路。”