1 Qwen3-Max介绍

Qwen3-Max,在今年云栖大会重磅发布,是目前通义千问家族中最大、最强的大模型。

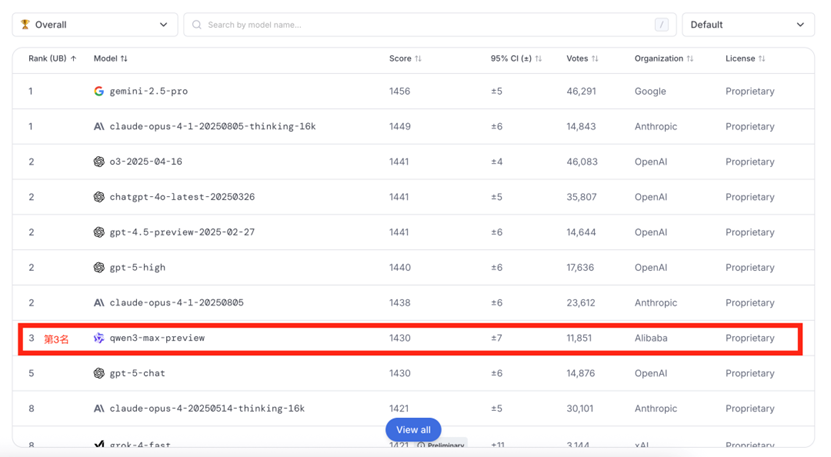

参数超万亿,在最权威的LMArena文本排行榜上,进入全球前三:

力压GPT-5,也是目前国内最强的大模型。

大家注意,这还只是Qwen3-Max-Preview,预览版。正式版一般会比预览版更强,根据报道,他们也会很快发布。

同时,Qwen3-Max又细分为instruct和thinking两款,怎么理解?instruct大概就是不需要长时间思考版,thinking就是需要较长时间思考版。

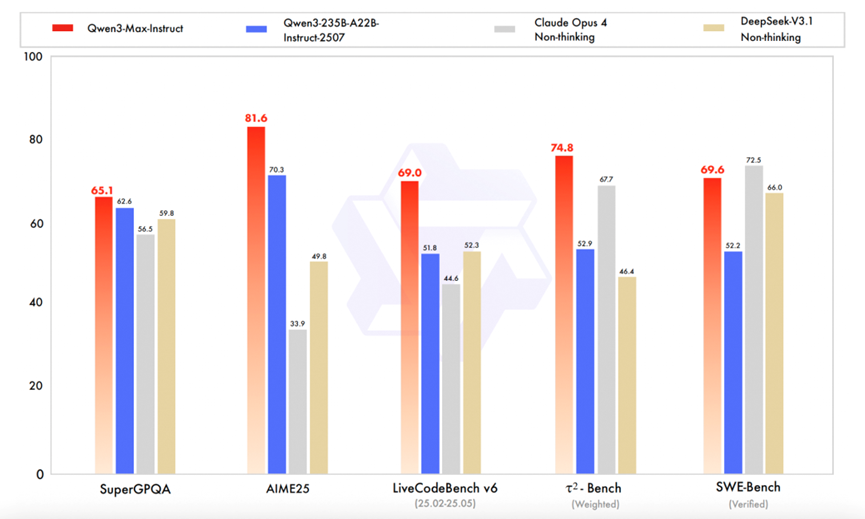

我们先来看看instruct版,我最关心的就是大模型的agentic能力,因为这方面能力强,才能真正发挥智能体的威力,这方面评估最权威的数据集Tau2-Bench,Qwen3-Max-Instruct取得了74.8分,领先于Claude Opus 4,排名第一:

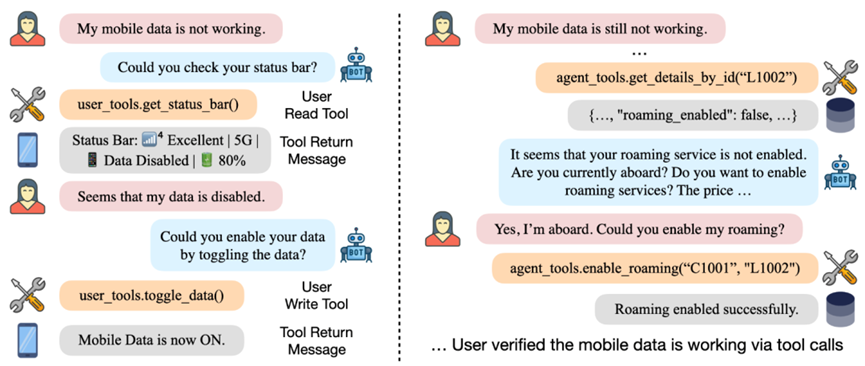

Tau2-Bench 数据集大概评估思路如下,允许用户与智能体交互:

thinking版,相比235B,有了大幅提升,在极具挑战性的数学推理基准测试 AIME 25 和 HMMT 上,都取得了满分,与GPT-5 Pro,Grok4 Heavy平起平坐:

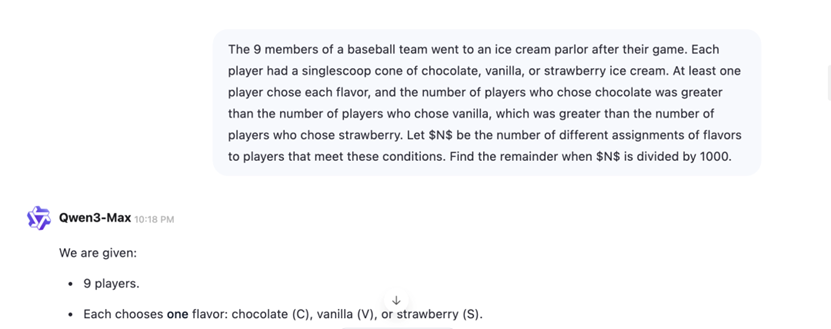

我会在文中第二节展示Qwen3-Max求解AIME 25其中一道题,让大家也直观感受下题目难度,和现在大模型的智商~ 看看能拿到100分,容易还是不容易。

2 Qwen3-Max实测

Qwen3-Max到底有没有,像他们宣传的这样厉害。我接下来从不同维度实测下。

首先,从很有难度的AIME 25数据集里,随便找一道题目,比如下面这道,提问Qwen3-Max:

下面是回答过程,大家感受下解题步骤:

并不是那么简单的中小学数学题,还是有相当不少的解题步骤、逻辑推导和算数推演的。在这样数据集上做到所有题目全对,并不容易,所以目前全球能做到满分的屈指可数。

再来一个实测,我前段时间做过一个练习题网站,有一些粉丝跟我反馈也想做类似网站,最简单的一个方法,直接截图复制我的样式,发给Qwen3-Max,如下图所示:

不到3分钟,Qwen3-Max就会生成这样的三个前端文件:

然后我打开看了下,和我给定的前端样式几乎大差不差:

Qwen3-Max在UI元素布局理解、捕捉上,足够到位了。

最后再来测试下Qwen3-Max对于外部网页检索和理解能力,提问它:DeepSeekMine介绍,因为这是我们团队开发的一个本地知识库产品,目前算是一个小众的产品,毕竟才上线几个月:

它对DeepSeekMine的总结,全面,也没有错误。右侧列举了参考的一些网页,也顺便帮我找到了目前都有哪些地方宣传了DeepSeekMine~ 真的方便,帮我节省时间。

3 Qwen3-Omni

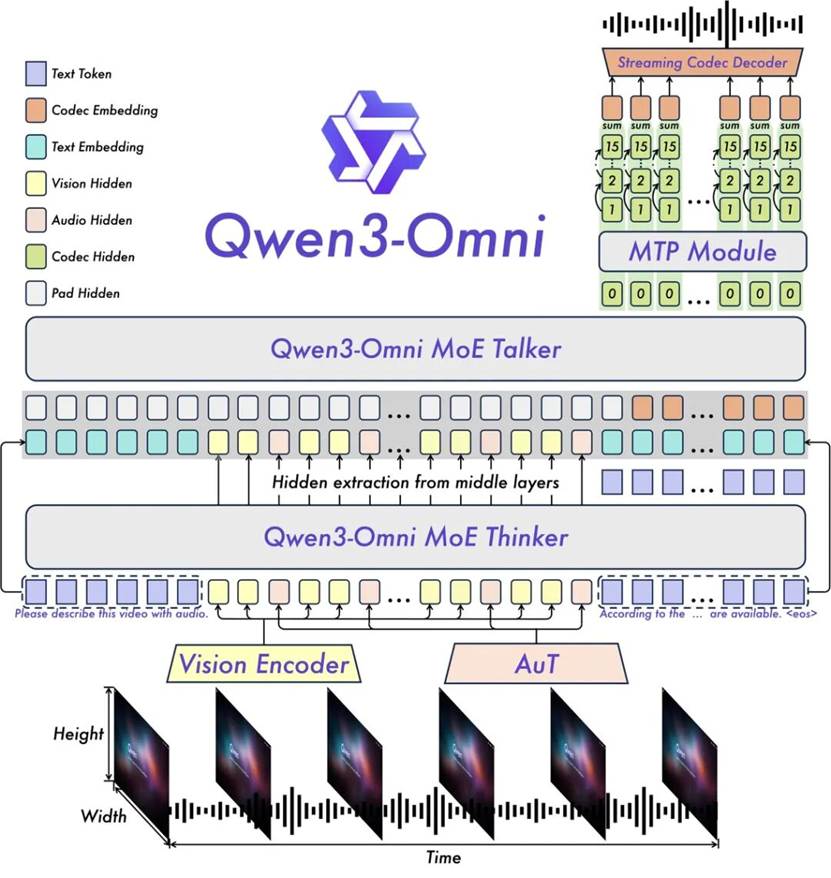

通义全家桶除了旗舰Qwen3-Max外,还有一个Omni模型,非常有意思。第一个真正意义上的多模态大模型,无缝融合了文本、图像、音频和视频,如下图所示:

Qwen3-Omni的多模态架构,带大家大概理解下。底部的 Vision Encoder 和 AuT 分别将图像帧与音频时序编码成特征,中间的 MoE Thinker 负责深度理解与推理,MoE Talker 负责跨模态交互和文本生成;

不同颜色方块代表文本、视觉、音频等隐藏状态在统一 Transformer 内混合处理;上方的 MTP 模块和 Streaming Codec Decoder 则实现多任务预测与实时语音输出,体现出统一处理文字、语音和图像的“全能”设计。

这有什么好处,一次性可以输出:文本,以及对应的音频、视频,以后打造数字人、落地数字人更方便了,因为文本,音频,视频可以大统一输出。

总结

最后简单来个小总结,主要根据2025 年云栖大会,阿里正式发布“通义千问”AI 全家桶,最受瞩目的旗舰模型 Qwen3-Max 以超万亿参数问世。

在 LMArena 文本榜单进入全球前三,性能直逼并超越 GPT-5,成为当前通义家族中最大、最强的大模型。

Instruct 主打高效交互,在 Tau2-Bench 智能体评测中以 74.8 分领跑全球;Thinking 则面向复杂推理,在 AIME 25 与 HMMT 等高难数学基准上取得满分,与 GPT-5 Pro 等顶尖模型并驾齐驱,展现了强大的推理与计算能力。

与此同时,阿里还发布多模态模型 Qwen3-Omni,可无缝处理文本、图像、音频和视频,实现一次生成多模态输出。